Appleの研究者による画期的な論文

2024年10月7日、AppleのAI研究チームが「GSM-Symbolic: Understanding the Limitations of Mathematical Reasoning in Large Language Models」という論文を公開した。この研究は、LLMの数学的推論能力に焦点を当て、その限界を明らかにしようとするものである。

研究の核心:LLMの真の推論能力の検証

研究チームは、LLMが表面的なパターン認識に頼っているのか、それとも本質的な理解に基づいて問題を解決しているのかを検証しようとした。この目的のために、彼らは「GSM-Symbolic」という新しいテスト方法を開発した。

GSM-Symbolicの特徴

GSM-Symbolicは、既存の数学的推論能力評価ベンチマーク「GSM8K」を改良したものである。この新しいテスト方法の特徴は以下の通りである:

- 問題の表現を柔軟に変更可能

- 使用される数字を自由に変更可能

- 「GSM-NoOp」という無関係な情報を含む問題集も作成

これらの特徴により、LLMの真の推論能力をより深く、多角的に評価することが可能となった。

実験結果:LLMの弱点が明らかに

研究チームの実験により、現在のLLMには以下のような弱点があることが判明した。

1. 数字や言い回しの変更に弱い

LLMは、問題の本質が同じでも、使用される数字や言い回しが変わると正解率が大幅に低下する傾向がある。これは、LLMが問題の本質を理解しているのではなく、単に訓練データのパターンを機械的に適用しているだけである可能性を示唆している。

2. 複雑な問題に弱い

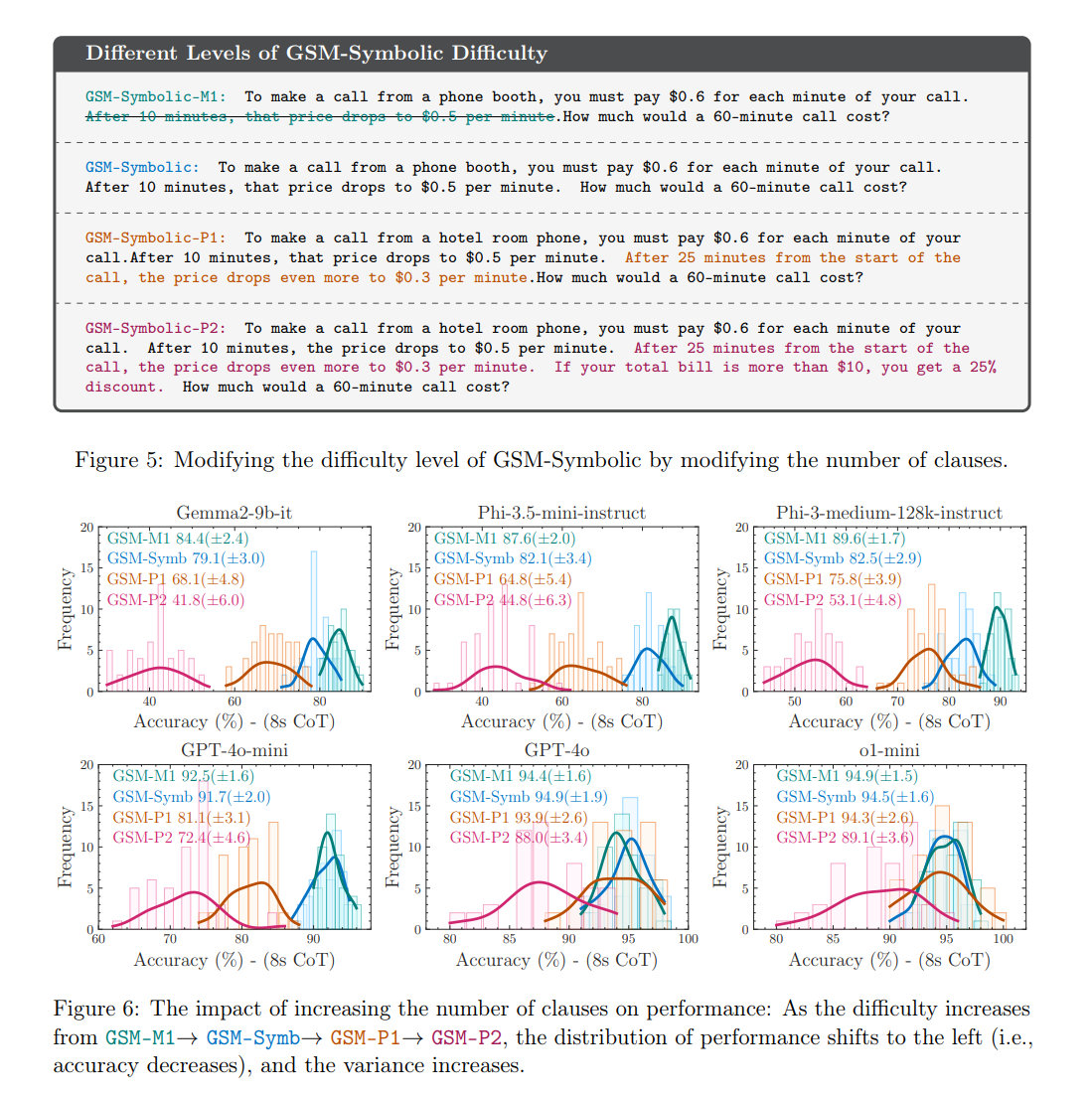

問題が長くなり複雑化すると、LLMの正解率は低下し、回答のばらつきも大きくなる。例えば、公衆電話の通話料金に関する問題を4段階の難易度に分けて検証したところ、難易度が上がるにつれて正解率が低下した。以下は、難易度別の問題例である:

- 最も簡単:1分あたり0.6ドルの固定料金で60分間の通話料金を計算

- やや難しい:10分を超えると料金が変動する場合の60分間の通話料金を計算

- 難しい:25分経過後にさらに料金が変動する場合の60分間の通話料金を計算

- 最も難しい:合計請求額が10ドルを超えると25%割引が適用される場合の60分間の通話料金を計算

3. 無関係な情報に惑わされやすい

問題文に、一見関係がありそうだが実際には回答に影響しない情報が含まれると、LLMは混乱しやすくなる。例えば、「キウイを〇個収穫した。ただし、そのうち△個は小さかった」という問題で、LLMは関係のない「小さいキウイの数」を全体から引いてしまうという誤りを犯した。

LLMの限界を克服するための課題

研究チームは、現在のLLMが真の数学的推論能力を獲得するためには、以下の課題を克服する必要があると指摘している:

- パターン認識を超えた高度な推論能力の開発

- 問題の本質を理解する能力の向上

- 無関係な情報を適切に処理する能力の強化

これらの課題を克服することで、LLMはより人間に近い推論能力を獲得し、複雑な問題解決に対応できるようになると考えられる。

LLMの現状と今後の展望

現在のLLMは、GPT-4やGPT-4-1106-previewなど、最新のモデルでさえも真の推論能力を獲得するには至っていない。しかし、これらのモデルは他のLLMと比較して高い性能を示しており、AI技術の進歩の速さを考えると、近い将来にはこれらの限界を克服する可能性も十分にある。

LLMの進化の可能性

- データの質と量の向上: より多様で高品質なデータセットを用いてLLMを訓練することで、パターン認識に頼らない真の理解力を養成できる可能性がある。

- アーキテクチャの改良: ニューラルネットワークの構造や学習アルゴリズムを改良することで、より複雑な推論を可能にする新しいモデルが開発される可能性がある。

- マルチモーダル学習の導入: テキストだけでなく、画像や音声などの他のモダリティを組み合わせた学習により、より豊かな文脈理解と推論能力を獲得できる可能性がある。

- 説明可能AIの発展: モデルの判断プロセスを人間が理解できるようにすることで、LLMの推論能力をより正確に評価し、改善することができるかもしれない。

結論:LLMの未来と人間との共存

Appleの研究者たちによる今回の研究は、現在のLLMが持つ限界を明確に示すと同時に、今後のAI研究の方向性を示唆するものでもある。LLMの真の推論能力の獲得は、単なる技術的な進歩以上の意味を持つ。それは、人間とAIの関係性を根本から変える可能性を秘めている。

今後、LLMがこれらの課題を克服し、真の推論能力を獲得していくにつれ、私たちは以下のような変化を期待できるかもしれない:

- より高度な問題解決支援: 複雑な数学的問題や論理的推論を必要とする課題において、LLMが人間の思考を補完し、新たな解決策を提案する。

- 教育分野での革新: LLMが学習者の理解度に合わせて適切な説明や問題を提供し、個別化された効果的な学習支援を実現する。

- 科学研究の加速: 大量のデータから意味のある仮説を導き出し、研究者の創造的思考を刺激する助手としてLLMが活躍する。

- ビジネス戦略の最適化: 複雑な市場動向や経済指標を分析し、より精度の高い予測と戦略立案をサポートする。

しかし、これらの可能性と同時に、私たちは常にAI技術の倫理的な使用と人間の判断力の重要性を忘れてはならない。LLMの能力が向上すればするほど、人間とAIの適切な役割分担と協調の在り方を考えることが重要になる。

Appleの研究者たちが明らかにしたLLMの現在の限界は、AI技術の発展における重要なマイルストーンとなるだろう。この研究結果を踏まえ、今後のAI開発がどのような方向に進んでいくのか、そして私たち人間社会にどのような影響をもたらすのか、注目していく必要がある。